在人工智能計算(智算)成為核心生產力的時代,智算網絡作為承載大規模并行計算任務的基礎設施,其性能與效率直接決定了模型訓練與推理的成敗。網絡擴展是提升智算集群算力規模的關鍵路徑,主要分為橫向擴展(Scale-Out)和縱向擴展(Scale-Up)兩種模式。理解其背后的網絡技術原理,對于網絡技術開發與架構設計至關重要。

一、Scale-Out(橫向擴展)網絡的技術原理

Scale-Out的核心思想是通過增加計算節點的數量來提升整體算力,通常用于構建由數百乃至數萬顆GPU/加速卡組成的大規模集群。其網絡技術聚焦于解決多節點間高速、低延遲、無阻塞的通信問題。

1. 核心技術:高帶寬、低延遲互連

* InfiniBand (IB) 與 RoCE (RDMA over Converged Ethernet):這是當前智算網絡的主流。它們都支持遠程直接內存訪問(RDMA)技術,允許計算節點繞過操作系統內核和CPU,直接訪問遠端節點的內存,從而極大降低通信延遲(可低至微秒級)和CPU開銷。IB網絡原生支持RDMA,并提供極高的吞吐量(如NDR 400Gbps)。RoCE則在以太網上承載RDMA,更易于與現有數據中心網絡融合。

- 無損以太網與擁塞控制:在Scale-Out的RoCE網絡中,大規模的“All-to-All”通信模式極易引發網絡擁塞,導致性能斷崖式下降。因此,無損以太網技術是關鍵,它通過優先級流量控制(PFC)、顯式擁塞通知(ECN)和基于時延的擁塞控制(DCQCN)等機制,實現零丟包,確保RDMA的高性能穩定運行。

2. 網絡拓撲:最大化對分帶寬

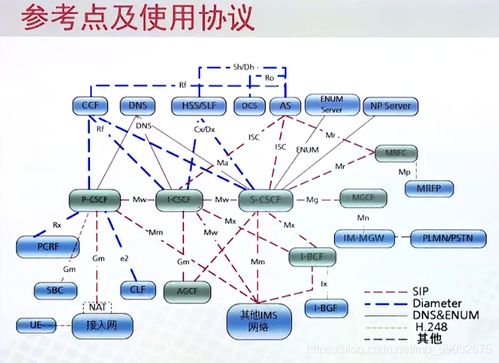

* Clos(Fat-Tree)拓撲及其變種:這是最常用的Scale-Out網絡拓撲。它通過多級交換機(Leaf-Spine或Leaf-Spine-SuperSpine)構建一個非阻塞網絡,使得任意兩個節點間都存在多條等價的并行路徑。其核心優勢在于能夠提供巨大的聚合帶寬和對分帶寬,滿足大規模參數同步(如All-Reduce)的通信需求。

- 超算網絡拓撲:Dragonfly, Torus:對于超大規模集群,像Dragonfly這樣的高階拓撲通過更少的網絡跳數(Hop)來降低全局通信的延遲,但需要更復雜的路由算法來避免熱點擁塞。

3. 通信庫與協議

* NCCL (NVIDIA Collective Communications Library):在GPU集群中,NCCL是實現多卡、多節點間高效集合通信(Collective Communication)如All-Reduce、All-Gather的核心庫。它針對特定的網絡硬件(如IB)和拓撲進行了深度優化,能夠自動檢測拓撲并選擇最優的通信算法和路徑。

網絡技術開發焦點:開發更智能的擁塞控制算法、設計支持更大規模的非阻塞拓撲、優化通信庫以更好地適配新型拓撲和硬件,以及實現網絡的自動化運維與性能調優。

二、Scale-Up(縱向擴展)網絡的技術原理

Scale-Up的核心思想是在單個計算節點或機箱內部,通過更緊密的互連技術將多個處理器(如GPU、CPU)集成在一起,形成一個共享內存或極高帶寬互聯的“超級芯片”或計算單元,從而提升單設備的計算密度和內部通信效率。

1. 核心技術:片內/板級超高速互連

* NVLink (NVIDIA) 與 Infinity Fabric (AMD):這是Scale-Up網絡的代表。例如,NVLink提供了GPU之間遠超PCIe帶寬(如NVLink 4.0可達900GB/s)的點對點直接互聯。它允許多個GPU共享統一的內存地址空間,形成“巨量GPU”,使得數據在GPU間遷移如同在本地內存中訪問,極大加速了模型并行和需要頻繁交換中間結果的場景。

- CXL (Compute Express Link):作為一種新興的緩存一致性互連協議,CXL允許CPU、GPU、內存池、加速器之間以更高效的方式共享內存資源,為異構Scale-Up計算提供了新的硬件基礎。

2. 封裝與集成技術

* 2.5D/3D 先進封裝:如CoWoS (Chip-on-Wafer-on-Substrate)、HBM (高帶寬內存) 技術等。它們通過硅中介層(Interposer)或直接堆疊,將多個計算芯粒(Chiplet)和內存芯粒以微米級的距離互連,實現了TB/s級的片上帶寬和極低的通信功耗,是Scale-Up達到極致性能的物理基礎。

3. 系統架構

* 異構計算架構:Scale-Up不僅僅是同類單元的堆疊,更是CPU、GPU、專用AI芯片(ASIC/TPU)等不同計算單元通過高速互連的緊密耦合。網絡技術需要為這種異構通信提供高帶寬、低延遲的統一接口和一致性內存模型支持。

網絡技術開發焦點:設計下一代片間互連協議(如更高帶寬的NVLink、開放標準的UCIe)、開發支持CXL的交換與內存池化技術、研究先進封裝下的信號完整性與熱管理,以及構建與之匹配的系統軟件棧(驅動、運行時、編譯器)。

三、Scale-Out與Scale-Up的協同與網絡技術開發展望

在實際的智算中心,Scale-Out和Scale-Up并非互斥,而是協同工作的。典型的架構是:節點內采用極致的Scale-Up技術(如多卡NVLink互聯),節點間通過高效的Scale-Out網絡(如IB/RoCE Clos網絡)連接。這形成了“強內部耦合,高外部帶寬”的層次化網絡體系。

未來的網絡技術開發將聚焦于以下幾個融合方向:

1. 跨層級協同:開發能夠感知從芯片內、板卡內到機架間所有網絡層次的統一調度與管理技術,實現全局通信優化。

2. 智算原生網絡:網絡不再是被動的數據傳輸管道,而是能主動感知AI作業的通信模式(如通信計算圖),并動態配置路徑和資源,實現“網絡即計算”的一部分。

3. 異構融合與開放標準:推動如CXL、UCIe等開放標準的發展,打破硬件壁壘,實現不同廠商芯片間高效、靈活的Scale-Up與Scale-Out組合。

4. 光互連與共封裝:隨著帶寬需求向Tb/s邁進,硅光技術、光交換和共封裝光學(CPO)將成為突破電互連瓶頸、降低功耗的關鍵,為下一代的Scale-Out和Scale-Up網絡提供基礎。

智算網絡的Scale-Out與Scale-Up技術,正從傳統的連接手段,演變為決定算力集群性能和效率的核心競爭力。其技術開發需要硬件、協議、拓撲、軟件、封裝等多領域的深度融合與持續創新。